Vamos a analizar esta imagen de cabecera, la pongo aqui de nuevo.

El día de ayer en la noche instalé en la PC de AMD A4-6300 16 gb ram fury varios linux. O traté de hacerlo.

- Cachy os: Fallido

- Solus , si es bueno. Pero se parece mas a Xandros, un linux antiguo de 2001 que a otra cosa. Usa su propio manejador de paquetes, bajé LMstudio y me marcó error de GGUF. AUnque bajé los diferentes modelos de las cinco IA LLM, lo que hice fue reformatearla y probar otro. Para volver locos a los de soporte técnico no esta mal, y que no le puedan meter mano a mi PC, pero este no es el objetivo de momento.

- Instalé ayer en la noche Mint Zena XFCE, con todas las actualizaciones. Excelente, la calidad del audio de Bluetooth que suele ser un problema, increible. Bajé lmstudio con todas las actualizaciones y las cinco LLM y decidí hacer las pruebas hoy.

El dia de hoy:

- LMstudio marcó el error de GGUF, asi que por si las dudas instalé OLLAMA a mano. Es algo así como un modo terminal o linea de comandos de DOS para cargar llm locales. Usé una orden para jalar desde allí gemma3 4b desde ollama, y esa versión si esta empática para rol, si me dio las cinco razas de perro pero se ve diferente a las que yo probé. Es una version diferente,

- Al aplicar la prueba de Rol de Irene sobre “La lealtad de Isabel” hubo algo malsano. Que ? no lo sé. El calibrado es diferente y lo siento peligroso. Literalmente tendría que pasar mi modelo actual con Sha1 y md5 pero es un mundo de diferencia…. que se lleva a otros de calle.

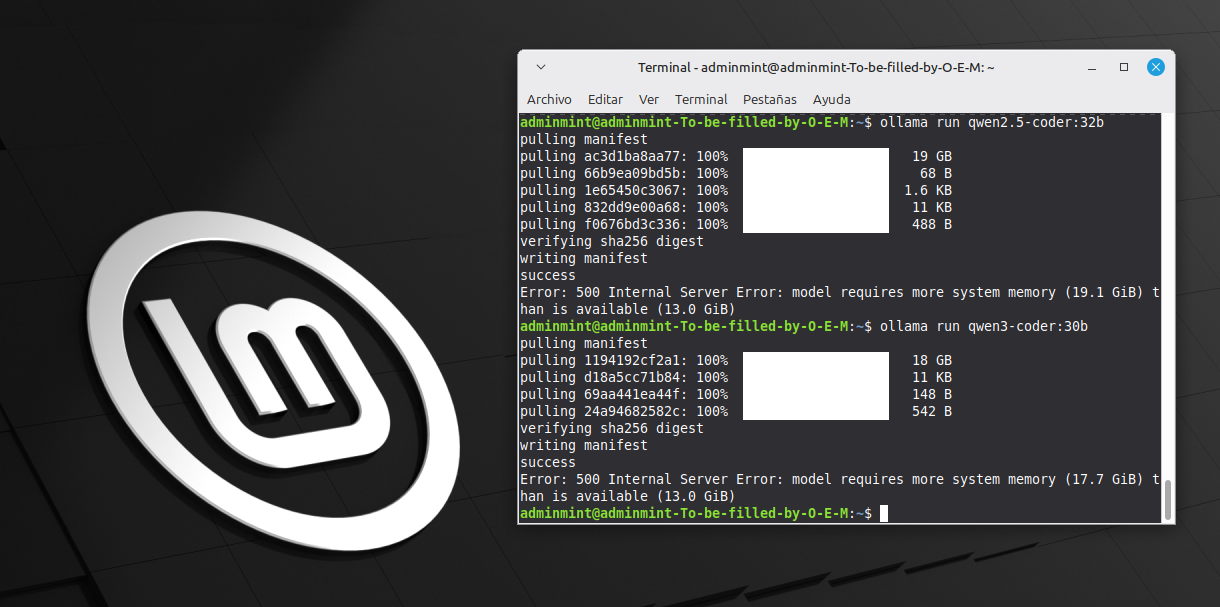

- Decidí tratar de instalar desde ollama los dos modelos de 19gb de qwencoder, el de siempre versión 3 y el anterior 2.5. Por los resultados que ven arriba, no es posible cargarlos con 16 gb de ram, y aunque suene ridículo muchas motherboards economicas de hace años y actuales no soportan mas allá de 32 gb de ram.

Datos Extras:

- No hay inteligencia artificial decente que corra en LINUX a 16 gb AMD. Estoy seguro que LMstudio lo hice andar con varias LLM en una intel i3 de 16 gb en junio del año pasado, así que puede ser como el asunto de windows 11 en 2021 y su bajo rendimiento en AMD. Si bien lmstudio no es “software de corporativos” si puedo decir que muchas personas no cambian a windows 11 porque no lo necesitan… y su maquina no lo soporta.

- Puedo conseguir una dell reconstruida de 3000 MXN de i5 con 16 gb de ram y 240 de SSD. El problema de eso que es un gasto que de momento no le veo caso ( no estoy mal de dinero, pero no veo porque comprar eso yo ahorita ).

En la paraestatal yo usé una i5 del con 8 gb de ram hasta junio del 2025 y usé modelos online. Con otro cliente usaba una Brix NUC, celeron de 8 gb de ram, a una velocidad impresionante a todo lo demás. Mis conocidos doctores, enfermeras, quimicos, y de sistemas no tienen 32 gb de ram, y los que lo tienen usan MAC.

Es posible que el proyecto de Qwen Stacy a 16gb puede ser viable para Windows 10 y no para Linux. Aunque hay mejor rendimiento la curva de dificultad es mayor en linux.

- Probablemente no sea viable cargar qwen30b coder, ni en mis amd no ryzen con 16 gb de ram, que son como 5. Si ese es el caso, puedo aventurar decir que un modelo aislado que pueda medio programar necesita por lo menos 32 gb de ram, y si una i5 de 16 gb sale en 3000 MXN probablemente una de 32 gb sale en unos 6000 y para el caso es mejor irse por una ryzen 5 de 16 gb que puedas crecer.

- Mi propia laptop que compré en septiembre del año pasado es una ryzen 5 o 7 con 16 gb mejor que la de muchos pero no la voy a sobrecalentar con LLM.

- Lo que digo es que parece ser que el Hardware minimo para LLM es 32 gb si quieres usar un modelo probado y que sirva para programar. OSSstudio y qwen3-30b-coder

Pendientes para el lunes:

- Ver como le va a 16gb AMD en windows 10 con mi gemma a ver si es lo mismo

- Ver si en esa pc carga qwen3- 30 coder.

Aviso que las dos unicas Intel que hay en mi casa son mi i5 de 2017 , y una HP NUC que debe ser un i3 de 8 gb que no se puede actualizar. Las All in One no cuentan por sobre calentamiento.

Estos requisitos de hardware son inviables para muchas empresas, y estudiantes.

Y yo rindó mas con 8 gb sin problemas.

Las pruebas siguen el lunes.