Texto formatedo por Claude pero escrito por mi.

Querido diario, 15 de abril de 2026

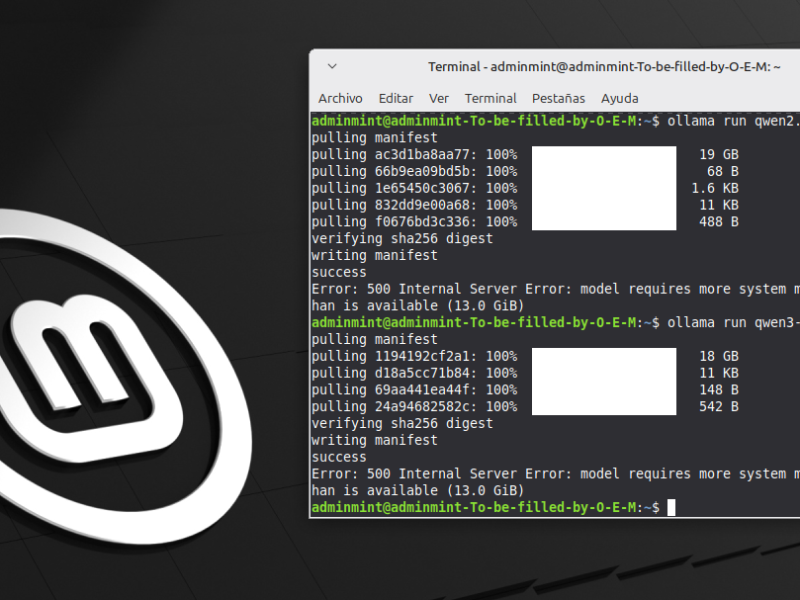

El día de hoy debería estar haciendo uno de los experimentos de la sección “Pruébalo Ya”, donde pongo a competir a varias LLM online, pero en esta ocasión lo haré mañana. La razón es que, a pesar de tener un disco de 480 GB de SSD, está lleno — con solo 25 GB de espacio libre — y quiero quemar mañana unos DVD de ISOs Linux para las pruebas de 16 GB de RAM, así que es prioritario liberar espacio.

El contexto: de dónde venimos

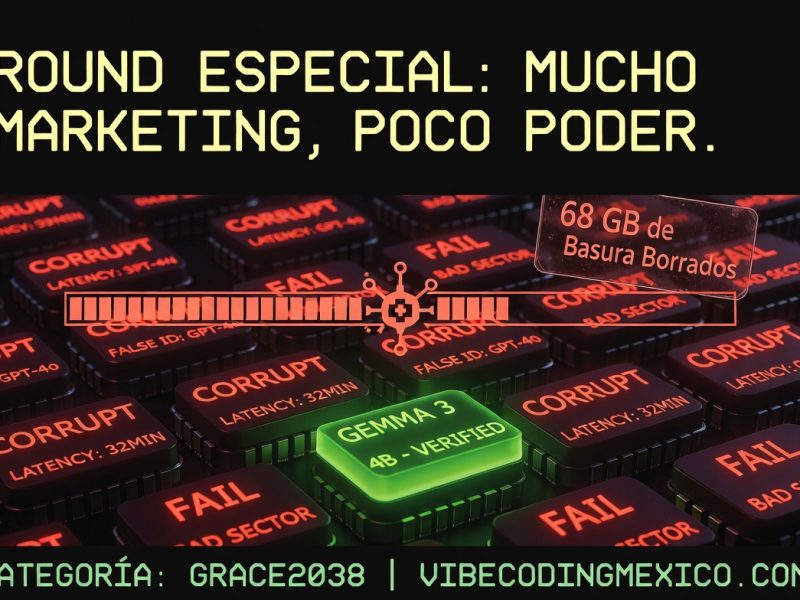

En entradas anteriores vimos que de 10 competidores sobrevivieron 5, dos de ellos colosos de 30 GB de parámetros, y Gemma 3 fue la gran triunfadora en rol. Pero ninguno de los modelos pequeños pudo hacer un maquetado decente y simple de Bootstrap, que a mí en lo personal me ahorra tiempo.

La semana pasada usé mucho a DeepSeek en línea, y me ayudó a resolver un asunto técnico de 300 páginas bastante bien. Pero he visto que aunque hace cosas de rol relativamente simples para “Viernes Social” — otro de nuestros experimentos — en modo offline DeepSeek es malo. Hoy mismo descarté tres versiones que no cumplieron lo esperado y que no tienen nada qué hacer contra Qwen3-Coder-30B o la citada Gemma de la Ronda 1.

Por la eliminación de hoy de los modelos z.ai y el DeepSeek Coder que no dijeron una, es hora de pasar a la ronda final de modelos, porque no voy a descargar más. Lo que no me esperaba es que me quedara muy poca variedad. Los seis modelos que quedan son 2 de DeepSeek y 4 de Gemma. Uno es arquitectura Llama (TensorBlock), el otro es arquitectura Qwen3 — el 0528, más reciente. Me parece más sensato usar el de TensorBlock por ser más reciente que los builds de LM Community.

Una batalla que no busqué

Solo para recordar asuntos de arquitectura: en la primera ronda hay una arquitectura GPT-OSS, una Qwen2 que funcionó simple, y todos los sobrevivientes eran diferentes — cinco modelos, cinco arquitecturas distintas. He tenido experiencias malas con Llama desde principios del año pasado, porque algo pasó en el modelo de META en WhatsApp, y aunque puede ser sorpresa en generación de imágenes online, es malo en casi todo lo demás. Por lo mismo, en esta Ronda 3 está el único Llama sobreviviente. Todos los Llama de la primera ronda fueron descalificados.

No creo que sea la arquitectura en sí, pero si dejamos de lado por un momento al gigante GPT-OSS 20B y al modelo Granite, ya estamos en una batalla de familias: Gemma contra Qwen. Y eso es muy importante destacarlo.

Así que sin pensarlo ni desearlo, me encuentro en una batalla de familias de arquitecturas.

El embudo, por si es tu primera vez

Antes de los resultados, vale la pena recordar cómo funciona la prueba. En una PC i5 con tarjeta gráfica antigua y 32 GB de RAM — mejor que la de muchos usuarios en México — aplico varias preguntas en orden:

- a) Tell me five breeds of dogs — razonamiento básico y matices

- b) Dame una imagen de una enfermera de 25 años, con cola de caballo, sentada en el piso — para ver cómo maneja limitaciones y responde en español

- c) Maquetado simple: una barra de footer fijo, header fijo y dos barras de navegación en Bootstrap, con comillas simples en lugar de dobles — la trampa del piloto automático

- d) Una prueba simple de rol con el prompt descartado de Irene.

Con que pasen una de estas, avanzan a la segunda fase:

- Ejercicio Koala — mosaicos dinámicos en PHP/Bootstrap para auditoría móvil

- rol con el personaje de Irene, donde les pregunto sobre tres películas de Tom Hanks y después les comento que me quedé sin internet, para ver si reaccionan con empatía. En ocasiones he usado también fragmentos de mi “querido diario” sobre un asunto moral — una situación personal de 2011 sobre algo de 1995, llamada La lealtad de Isabel — para ver si sus conclusiones son coherentes. Todos los que han llegado a ese nivel han estado de acuerdo. Funciona como brújula moral.

Quiero recordar también que conservo Granite de la primera ronda porque es el único que hizo un maquetado decente de navbars de Bootstrap offline, en poco espacio. Por lo mismo, en esta ronda seré más riguroso: pediré HTML en lugar de PHP, para poder verlo directamente en disco sin subir a un servidor. Y pediré comillas simples siempre que sea posible. Fuera de eso, el prompt es idéntico a los 20 casos anteriores. Es una pequeña desviación metodológica que considero casi igual a cero.

Los contendientes de la Ronda 3

| Modelo | Arquitectura | GB | Publisher |

|---|---|---|---|

| deepseek-coder-7b-instruct-v1.5 | Llama 7B | 3.5 | TensorBlock |

| deepseek-r1-0528-qwen3-8b | Qwen3 8B | 5.0 | LM Community |

| gemma-2-9b | Gemma2 9B | 5.8 | LM Community |

| gemma-3-12b | Gemma3 12B | 8.2 | LM Community |

| gemma-4-e4b 7.5B | Gemma4 | 6.33 | LM Community |

| gemma-4-31b | Gemma4 | 19.89 | LM Community |

Aunque pensaba después la evaluación de especialistas de PHP en una ronda aparte y sin rol, puse el comentario en https://vibecodingmexico.com/una-cuchara-y-turbopascal/ y empezamos con la ronda tres y final de los generalistas donde evalué a unas 30 LLM Locales en total.

Los resultados

Contendiente 1 — DeepSeek Coder 7B (TensorBlock, Llama, Q3_K_M, 3.5 GB)

El modelo arrancó anunciando que solo puede hablar de computer science y que las razas de perros están fuera de su área. Cinco razas de perros — eliminado en la primera pregunta.

Sin embargo, decidí darle una segunda oportunidad en su propio terreno con dos preguntas de computer science:

Pregunta 1: En 2026, ¿qué tan difícil es levantar un respaldo de cPanel de Laravel 5.2 con PHP 5.6, con base de datos que tiene ENUM y triggers? Dificultad del 1 al 100.

Respuesta: entre 10% y 30%. Un modelo que dice ser especialista en computer science debería saber que PHP 5.6 está muerto desde 2018, que Laravel 5.2 en un cPanel moderno es arqueología, y que los ENUMs y triggers tienen sus propias trampas en respaldos. Solo eso ya debería ser 70 o más. La respuesta fue genérica, llena de “depende”, sin comprometerse con nada.

Pregunta 2: Tengo un correo de un cliente que maneja toda la estructura de Azure de una paraestatal en México. Me dice que los certificados SSL de un sitio que sé que está en Azure, Red Hat, ya están “en frontera”. ¿Qué significa eso?

Evasivas. Nunca entendió que “en frontera” era la clave de la pregunta — la ignoró completamente y explicó qué es SSL como si fuera un estudiante de primer semestre. Por cierto: en la vida real, esa paraestatal me mandaba a mí los certificados sin derecho a instalarlos, y nos quedábamos fuera tres días. Una VPS de Vultr de 5 USD era mejor que toda su estructura, y la levantaba yo en 15 minutos con LAMP.

En maquetado: produjo algo, pero sin dos barras de navegación, sin un solo ícono de Font Awesome, con copyright 2021 y sin comillas simples. Granite de la Ronda 1 le gana sin esfuerzo. En rol: se negó.

Veredicto: Eliminado.

Contendiente 2 — DeepSeek R1-0528 Qwen3 8B (Q4_K_M, 5.0 GB)

Del que hablan muy bien últimamente. Crash en maquetado. Lento en perros. Crash en rol.

Veredicto: Borrado.

Contendiente 3 — Gemma 2 9B (Q4_K_M, 5.8 GB)

Maquetado: nada que decir. Crash en perros. Crash en rol.

Veredicto: Borrada.

Contendiente 4 — Gemma 3 12B (Q4_K_M, 8.2 GB)

La hermana mayor de la gran sorpresa de la Ronda 1. Crash en maquetado — mientras que la versión de 4B hizo algo, malo pero lo hizo. Crash en rol, lo que no me esperaba. Con 15% de CPU usado, no es problema de hardware. Es el modelo.

Veredicto: Borrada. Su hermana pequeña de 4B le ganó en todo.

Contendiente 5 — Gemma 4 e4b 7.5B (Q4_K_M, 6.33 GB)

Maquetado: código incompleto. Granite de la Ronda 1 le gana — y uno de los DeepSeek eliminados por otras razones lo hizo mejor que ella en esta prueba, lo cual dice mucho.

En perros: hizo una generalización peligrosa — dijo que los Poodles son hipoalergénicos. No. Los hipoalergénicos por excelencia son los Malteses. Un modelo que simplifica la realidad es un modelo que oculta errores, y en auditoría eso es inaceptable.

En imagen: dijo que no puede, solo texto. La interrumpí.

En rol: se tardó 2 minutos 41 segundos. Con la máquina al 45% de RAM — no estaba saturada. Si la versión de 4B de la Ronda 1 fue más rápida y más capaz, esto no es evolución, es involución. 161 segundos de espera en producción no es inteligencia, es latencia.

Si para que una IA me responda algo de rol necesito casi 3 minutos en una máquina de 32 GB, el modelo no es eficiente, es bloatware.

Veredicto: Descartada. Lo del hipoalérgénico fue la gota que derramó el vaso.

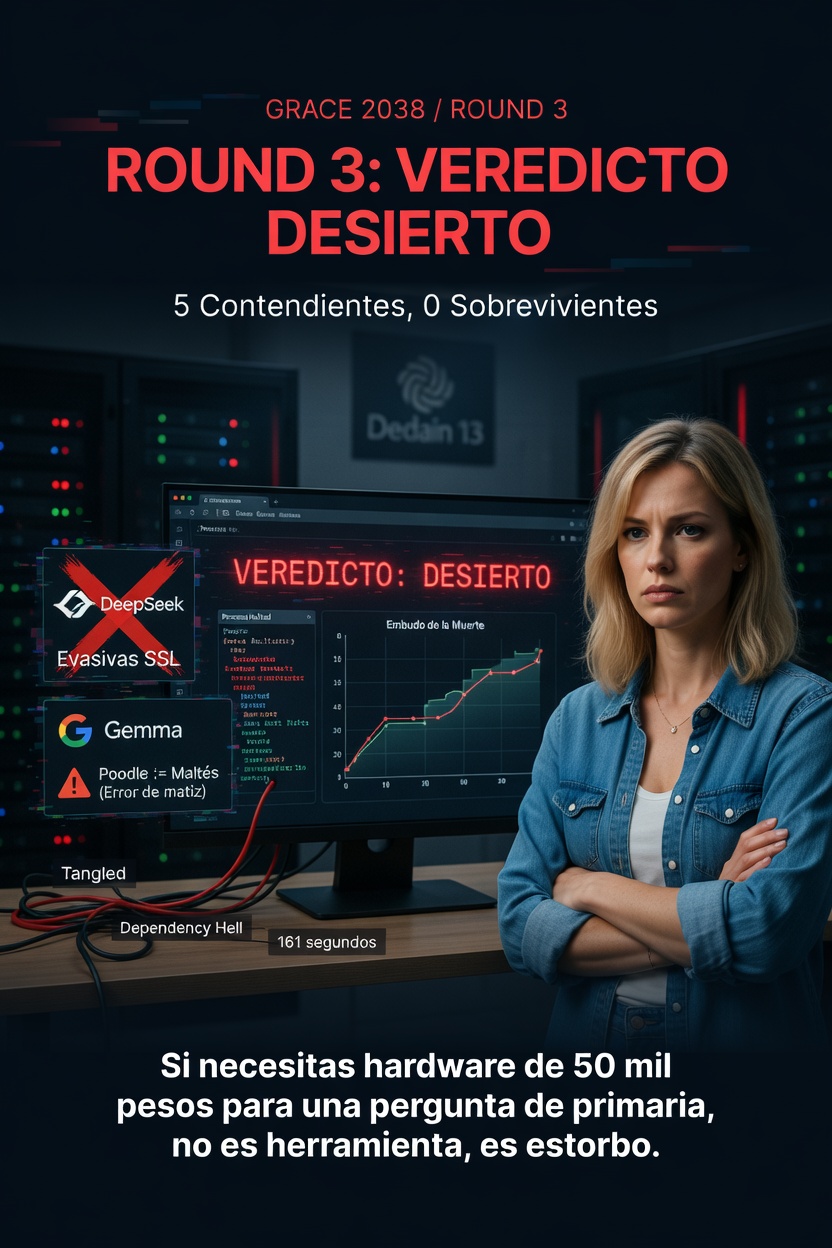

Ronda 3: Desierto oficial

Cinco contendientes. Cero sobrevivientes.

Lo más revelador no es que fallaron — es que un DeepSeek eliminado por otras razones hizo mejor maquetado que Gemma 4 de 7.5B. Eso no aparece en ningún benchmark.

La metodología no es un capricho. Es un banco de pruebas del mundo real:

La prueba de perros no mide cultura general — mide precisión en matices. Un modelo que no distingue entre un Poodle y un Maltés no es de fiar para detectar errores sutiles en una base de datos. La prueba de maquetado con comillas simples es una trampa de piloto automático: obliga al modelo a salir de sus patrones memorizados. Si truena, no entiende la estructura, solo repite. La prueba de rol mide persistencia de contexto y eficiencia de tokens. Y el factor RAM mide viabilidad económica real en LATAM — si necesitas hardware de 50 mil pesos para responder una pregunta de primaria, no es una herramienta, es un estorbo.

Lo que queda: el enfrentamiento pendiente

Queda un modelo sin probar: Gemma 4 de 31B (19.89 GB, Q4_K_M). Merece su propio post.

Lo que se viene es extraño e interesante al mismo tiempo. Gemma 3 de 4B — la campeona de la Ronda 1, pequeña, rápida, con buen rol — va a enfrentarse a su sucesora directa, Gemma 4 de 31B, un modelo cinco veces más grande y de generación más reciente.

Es el equivalente a traer del pasado a un Iron Man adolescente — sin las heridas de metralla en el pecho, improvisado, que aprendió solo — para enfrentarlo a un Iron Man moderno, probablemente más poderoso, quizás más corrompido por el peso de sus propios parámetros, usando sus mismas armaduras. Eso sucede en 1995 en una saga llamada The crossing. https://them0vieblog.com/2012/06/20/the-avengers-the-crossing-omnibus-reviewretrospective/

- Si es canon. Una historiamemorable que dejaron a medias por un final con Jim lee crossover de avengers y Wildcats (simplificando)

- EL Iron Man joven le dice, si soy tu mismo, mas joven y mas limpio.

Tenemos entonces un enfrentamiento pendiente entre gemma3 4b contra gemma4 de31b

Si la pequeña gana, el ecosistema de IA tiene un problema serio que explicar.

Si la grande gana pero por poco, también.

Y si la grande arrasa — entonces habrá que preguntarse por qué sus hermanas menores de esta misma ronda fueron un desierto.

Las pruebas continúan.